Chi crea campagne di disinformazione online? Con quali obiettivi, con quali mezzi? Come individuarle e combatterle?

Dopo il nostro ultimo articolo sulle fake news, inauguriamo la rubrica HOT! con un’intervista a Filippo Trevisan, Professore Associato di Comunicazione Pubblica presso l’American University School of Communication a Washington.

HOT! è lo spazio in cui approfondiamo tematiche sulla comunicazione, l’innovazione tecnologica e molto altro, insieme ai più grandi professionisti del settore.

Chi crea campagne di disinformazione online?

Le campagne di disinformazione vere e proprie presuppongono uno o più obiettivi strategici ben definiti che vanno oltre il semplice ritorno economico diretto che può derivare dalla disseminazione di “fake news” intese più in generale. Per questa ragione, dietro a campagne di disinformazione tendono a esserci entità governative, agenzie para-statali, o comunque gruppi vicini o controllati da uno stato, oppure da un partito politico o gruppi di interesse che mirano a influenzare dinamiche politiche interne al proprio paese, in altri paesi, o a livello internazionale. Sono operazioni a lungo termine con fini politici per cui sono disponibili risorse considerevoli. Chi le pianifica sa sfruttare le dinamiche delle piattaforme social a proprio vantaggio avendo accesso a una serie di “opinion leader” che ne diffondono il messaggio, volontariamente o, molto spesso, involontariamente perché ne percepiscono un vantaggio indiretto in termini di visibilità e introiti economici.

La distinzione quindi è tra fake news con obiettivo di monetizzazione attraverso il clickbaiting e campagne di disinformazione con obiettivi politici?

Si’, in sostanza la disinformazione tout court e’ legata a una chiara intenzionalita’, anche se poi in pratica il clickbaiting per monetizzazione e la disinformazione strategica si incrociano e si sovrappongono spesso.

Ci sono casi noti che possiamo citare? Si è parlato molto de “La Bestia”, l’apparato che gestiva la comunicazione della Lega di Salvini.

La cosiddetta “Bestia” di Salvini era forse piu’ un apparato di “ascolto” per cercare di captare i trend social della potenziale base leghista e proporre contenuti (veritieri o meno) che cavalcassero questi trend. Tra gli esempi piu’ eclatanti di disinformazione recente c’e’ sicuramente la narrazione della “big lie” (la “grande truffa”) che sostiene la vittoria di Donald Trump alle elezioni presidenziali americane del 2020.

Come individuarle?

Al di là dello stare in guardia nei confronti di elementi ovviamente sospetti come foto ritoccate e video deep-fake, non è sempre così semplice riconoscere la disinformazione. Buona parte di questa difficoltà deriva dal fatto che non tutti i contenuti di ciascuna campagna di disinformazione sono necessariamente falsi. Anzi, l’introduzione di dettagli accurati all’interno di una narrazione fuorviante è strategicamente utile perché contribuisce a rendere la sua individuazione più difficile e ne allarga potenzialmente la platea, rendendo suscettibili anche persone solitamente più attente alla provenienza dell’informazione. Poste queste difficoltà, la reticenza nel dichiarare le fonti, il richiamo costante a pregiudizi e stereotipi, il tentativo di spiegare in termini semplicistici problemi complessi, l’allusione e la tendenza a suggerire implicitamente piuttosto che dimostrare certe conclusioni, la pretesa di rivelare qualcosa che qualcuno ha voluto tenere “nascosto” sono generalmente segnali più o meno evidenti di disinformazione. Inoltre, un altro importante segnale è l’invito a chi dissente con la narrativa sostenuta dai disinformatori a provare che le cose non stanno effettivamente così, spostando l’onere della prova su altri e costringendoli a dimostrare l’assenza di evidenze, un compito generalmente arduo e a volte impossibile.

Ci sono organizzazioni autorevoli che monitorano queste attività a cui consigli di rivolgersi?

Ce ne sono diversi. Alcuni, come FactCheck.org o Politifact negli USA e Open in Italia si occupano principalmente di verificare la fattualita’ di certe notizie o certe affermazioni. Altri, come Right Wing Watch negli USA, cercano di dare una visione piu’ ampia, presentando anche i collegamenti tra i vari attori coinvolti in tentativi di disinformazione.

Come si struttura una campagna di disinformazione online?

Le campagne di disinformazione di oggi riprendono strategie di propaganda tradizionali, aggiornandole per l’era digitale. Un caposaldo di queste strategie è lo sfruttamento di fratture sociali preesistenti basate su pregiudizi razziali o religiosi come nei confronti delle persone di colore o di religione ebraica, sospetti nei confronti di gruppi con interessi economici significativi come l’industria farmaceutica, oppure incompatibilità basate sulla demonizzazione degli avversari politici. La disinformazione non apre necessariamente nuove fratture, ma piuttosto cerca di acuire quelle esistenti. Gli algoritmi che regolano il flusso di informazioni sulle maggiori piattaforme social si sono rivelati ottimi vettori per questo tipo di contenuti che tendono a suscitare reazioni forti e più costanti rispetto ad altri contenuti meno semplicistici e scandalistici. Questa operazione èinoltre facilitata dal recente declino della fiducia nei confronti di mass media di tipo tradizionale come TV e giornali in paesi come gli Stati Uniti e l’Italia, dove per esempio WhatsApp è emerso come un importante canale di informazione peer-to-peer negli ultimi anni.

Come si distinguono bot e profili fake?

Bot e profili fake sono spesso contraddistinti da segnali abbastanza chiari, ma identificarli richiede un po’ di tempo e ricerca che molti utenti non hanno modo di effettuare. Errori grammaticali ricorrenti sono un segnale piuttosto evidente, come anche il fatto che un profilo esista da poco tempo, oppure che posti solo ed esclusivamente a proposito di un singolo argomento, con attitudine polemica, o esclusivamente in risposta ad altri. Per intenderci, non tutti i bot agiscono in maniera negativa. Alcuni sono programmati per amplificare contenuti validi su tematiche importanti, mentre altri sono in grado di fornire informazioni utili rispondendo a domande più o meno semplici, ma dovremmo generalmente sospettare di quelli che mostrano i segnali che ho elencato. In aggiunta a bot e profili fake, bisogna anche stare in guardia nei confronti di “super-utenti” reali con una platea social considerevole e una chiara agenda politica, che spesso ricoprono ruoli ancora più importanti all’interno delle campagne di disinformazione e risultano essere responsabili per buona parte della diffusione di questi contenuti.

Qual è il ruolo delle campagne di disinformazione sulle elezioni USA? E sulla guerra in Ucraina?

La disinformazione online ha giocato ruoli leggermente diversi nelle campagne elettorali USA del 2016 e del 2020. Nel 2016 l’obiettivo principale fu quello di persuadere parte dell’elettorato Democratico – per esempio, gli elettori Afro-Americani nelle grandi aree urbane della cosiddetta “rust belt” tra la Pennsylvania e il Michigan, e i sostenitori di Bernie Sanders in tutti gli stati considerati in bilico – a non votare. Nel 2020 l’obiettivo fu quasi l’opposto, cioè mobilitare l’elettorato Repubblicano a votare di persona per scongiurare ipotetici brogli. La diffusione di questa narrativa su internet a partire da mesi prima delle elezioni è poi stata funzionale a quello che è seguito, consentendo a Donald Trump di non dover mai ammettere la propria sconfitta. Per quanto riguarda la guerra in Ucraina, da parte russa ci sono stati chiaramente dei tentativi di disinformazione che si sono innestati su dinamiche già avviate e che mirano a indebolire la risposta dell’Occidente minandone l’unitàinterna, soprattutto negli Stati Uniti. Sono tentativi che sembrano essere andati a buon fine solo parzialmente dato che anche alcuni dei gruppi più estremisti negli USA si sono trovati spiazzati difronte all’invasione dell’Ucraina, ma che hanno comunque aperto un fronte interno capace di distogliere l’attenzione dalla necessità di una risposta unitaria.

Come si risolve il problema?

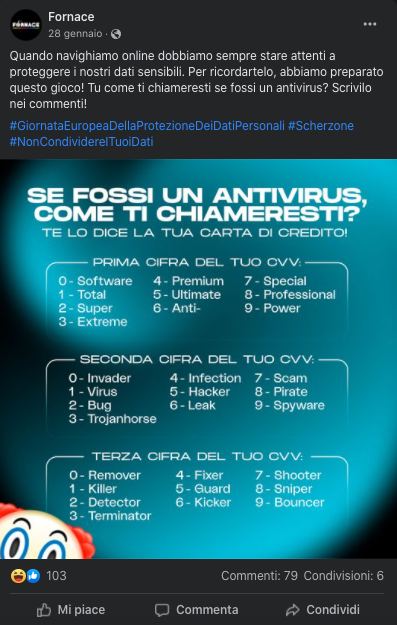

Al di là del potenziamento delle campagne di alfabetizzazione digitale, incluse quelle rivolte a fasce della popolazione più avanti con gli anni che oggi rappresentano una grossa parte degli utenti di piattaforme come Facebook e che si sono dimostrate particolarmente suscettibili alle sirene della disinformazione, il problema di fondo rimane nel modo in cui sono strutturate oggi le piattaforme social. Da un lato, per risolvere veramente il problema della disinformazione digitale compagnie come Facebook, YouTube, e TikTok dovrebbero smettere di definirsi semplicemente come canali di distribuzione più o meno neutrali e cominciare a comportarsi come i veri e propri mezzi di informazione che sono ormai diventati. Questo gli consentirebbe di applicare standard molto più stringenti nei confronti dei contenuti che appaiono sulle loro piattaforme. Questo ovviamente implicherebbe un ripensamento di fondo del modello economico di queste piattaforme che al momento è orientato esclusivamente all’ “engagement” (ovvero la condivisione, i commenti, e le reazioni) e che inevitabilmente finisce per privilegiare contenuti pensati per suscitare reazioni forti tramite il richiamo a pregiudizi, preconcetti e narrative preesistenti. Francamente, penso che questo sia molto difficile se non impossibile senza un intervento legislativo oppure in seguito a un abbandono di massa da parte di utenti insoddisfatti dal livello dei contenuti che circolano su queste piattaforme.

Dal momento che una piattaforma privata è il luogo in si tiene la discussione pubblica come una moderna agorà, non credi sia pericoloso che un’organizzazione privata abbia il potere di censurare determinate opinioni?

Potremmo parlare di censura se a monitorare le informazioni e i commenti fosse un’agenzia governativa. Chi si iscrive a una piattaforma gestita da una compagnia privata sottoscrive delle regole comuni che dovrebbe rispettare assumendosi le proprie responsabilita’ in caso di affermazioni fuorvianti o prive di fondamento. Un cambiamento di rotta da parte delle piattaforme per dare priorita’ a contenuti e fonti di qualita’, anziche’ promuovere esclusivamente cio’ che ottiene piu’ reazioni da parte degli utenti, e’ fondamentale se vogliamo limitare la diffusione della disinformazione.